- ستيف هارفي ومشاهير آخرون يواجهون سرقة الهوية المدفوعة بالذكاء الاصطناعي، حيث يتم استخدام صورهم في عمليات الاحتيال.

- التزييف العميق المولد بالذكاء الاصطناعي، الذي كان في البداية ممتعًا، أصبح الآن يمثل مخاطر خطيرة من الخداع، كما يتضح من عمليات الاحتيال التي تتقمص المشاهير.

- يدعو هارفي إلى إصلاح تشريعي، باحثًا عن عقوبات لاستخدام الذكاء الاصطناعي بشكل غير صحيح ومحاسبة المنصات التكنولوجية التي تستضيف محتوى ضار.

- تزداد دعماً ثنائياً لمشروع قانون “لا للتزييف”، الذي يهدف إلى معاقبة الصور والأصوات المولدة بالذكاء الاصطناعي بدون إذن.

- تحذر جماعات المناصرة العامة من الإفراط في التنظيم والتهديدات المحتملة للحرية الإبداعية وحقوق التعديل الأول.

- تقوم شركات مبتكرة مثل “فيرميليو للذكاء الاصطناعي” بتطوير أدوات مثل “TraceID” لمكافحة الزيادة في المحتوى غير المصرح به المولد بالذكاء الاصطناعي بفعالية.

- تشير الزيادة السريعة في التزييفات العميقة إلى الحاجة الملحة لأساليب أكثر تطورًا للسيطرة على المحتوى الرقمي.

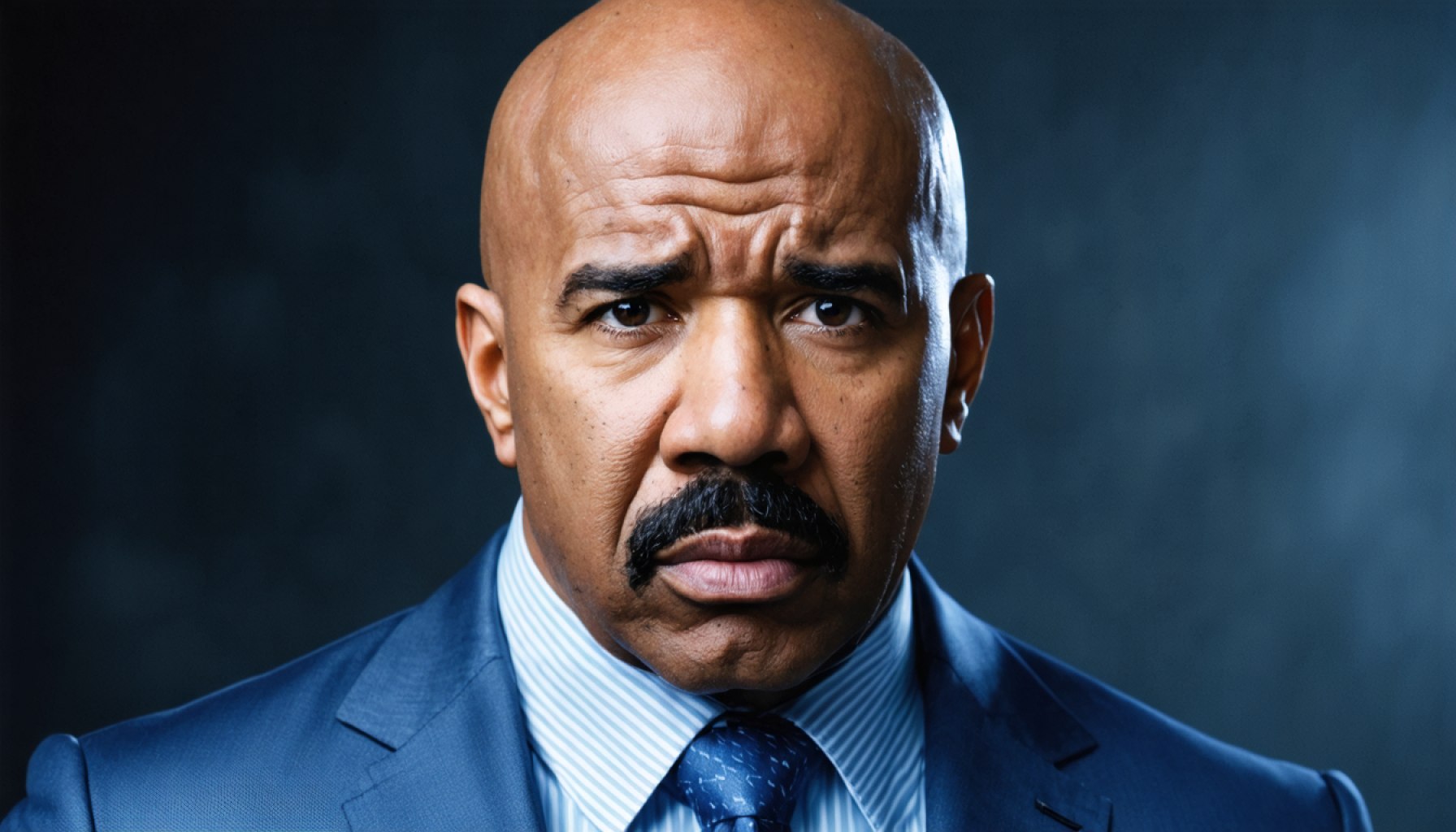

يواجه ستيف هارفي، المضيف الجذاب المعروف بنصائحه القلبية على الهواء ومزحه أثناء تقديم برنامج “Family Feud”، تهديدًا رقميًا لم يكن حتى ذكائه الحاد قادرًا على توقعه. عالم الذكاء الاصطناعي، الذي كان مليئًا بالإمكانات للابتكار الرائد، يهدد الآن الهويات الشخصية بموجة شريرة من الخداع.

في البداية، كانت الميمات المولدة عن طريق الذكاء الاصطناعي التي تظهر هارفي تصور شخصيته بشكل فكاهي، حيث ظهر ككل شيء، من نجم روك إلى ساحر هارب من الجحيم، وكان يتشارك الضحك على وسائل التواصل الاجتماعي. كانت هذه الإبداعات الساخرة أشباحًا غير ضارة من قدرة الذكاء الاصطناعي المشاغبة. ومع ذلك، استغلت قوى مظلمة نفس التكنولوجيا لتزوير عمليات احتيال تتلاعب بصورة هارفي وصوته، مغرية الضحايا بالوعود الكاذبة بأموال حكومية.

لا يقتصر هذا الظاهرة على هارفي فقط. فقد واجه مشاهير مثل تايلور سويفت وجو روغان تحديات مشابهة عندما تم استخدام صورهم الرقمية بطريقة احتيالية لخداع المعجبين غير المدركين في جميع أنحاء العالم. وفي تحول غريب من الفاندوم إلى الاحتيال، وقعت امرأة في فرنسا ضحية لذلك، وخسرت 850,000 دولار بعد أن انتحر الذكاء الاصطناعي باسم براد بيت في طلب للمساعدة.

منزعجًا من الإساءة المتفشية، ينقل هارفي كفاحه بعيدًا عن الكاميرا، داعيًا بشدة إلى إصلاح تشريعي. ويجادل ليس فقط بفرض عقوبات على المحتالين، لكن أيضًا بمحاسبة المنصات التكنولوجية التي تستضيف المحتوى الضار. لقد وجد هارفي حلفاء في مجموعة من السياسيين الثنائيين الذين يسعون إلى تعزيز مشروع قانون “لا للتزييف” — التشريع الذي يهدف إلى معاقبة الاستخدام غير المصرح به للصور والأصوات المولدة بالذكاء الاصطناعي.

مع الأصوات من كبار اللاعبين في الصناعة، مثل أكاديمية التسجيل ورابطة ممثلي الشاشة، التي تتردد صداها في مطالبه، يتم بناء حركة حاسمة. يجادل هارفي وزملاؤه بأنه بينما تعتبر حرية التعبير أمرًا أساسيًا، فإن تشويه حديث الشخص دون موافقته يهاجم الحريات الشخصية — وينادون الكونغرس للتحرك بشكل حاسم.

في وسط هذه الحملة للإصلاح، تظهر أصوات الحذر. تحذر جماعات المناصرة العامة، التي تخشى من التنظيم الزائد، من التهديدات المحتملة لحقوق التعديل الأول. ويشيرون إلى أن مشروع قانون “لا للتزييف” قد يؤدي بشكل غير متعمد إلى زيادة ضخمة في التقاضي، مما قد يعيق التعبير الإبداعي بدلاً من حمايته.

في هذه الأجواء المحتدمة، تتحرك الابتكارات بسرعة. تدخل شركات مثل “فيرميليو للذكاء الاصطناعي” إلى المعركة. بتكنولوجيا مثل “TraceID”، يتتبعون ويدمرون المحتوى غير المصرح به بسرعة، مما يوفر بصيص أمل للمُثقلين رقميًا. بينما كانت سنة 2018 تسجل 19,000 قطعة محتوى مزيف، الآن يظهر مليون قطعة جديدة في الدقيقة — وهو وتيرة مقلقة تتجاوز طرق السيطرة التقليدية.

مع مصداقية مسيرته المهنية على المحك، لا يقوم هارفي بحماية اسمه فقط — بل هو مشترك في معركة حاسمة من أجل النزاهة الرقمية. تكشف رحلته من خلال مشهد الذكاء الاصطناعي المتطور عن حقيقة عميقة: في العصر الرقمي، حماية صوت المرء أمر بالغ الأهمية، lest it be co-opted by shadows in search of easy victims.

المعركة ضد انتحال الهوية بالذكاء الاصطناعي: كيف يناضل ستيف هارفي وآخرون من أجل النزاهة الرقمية

فهم تهديد الانتحال الناتج عن الذكاء الاصطناعي

لقد أحدث الذكاء الاصطناعي ثورة في العديد من الصناعات، موفرًا Innovations تتراوح بين الرعاية الصحية إلى الترفيه. ومع ذلك، فإن إساءة استخدام تكنولوجيا الذكاء الاصطناعي، خاصة في إنشاء التزييفات العميقة فائقة القابلية للتصديق، تشكل تهديدًا كبيرًا. يجد مشاهير مثل ستيف هارفي، تايلور سويفت، وجو روغان أن هوياتهم قد تم استغلالها بواسطة تقليد رقمي، مما أدى إلى عمليات احتيال تتلاعب بالمعجبين غير المدركين.

صعود التزييفات العميقة: ليس مجرد مشكلة للمشاهير

تمتد مشكلة التزييفات العميقة إلى ما هو أبعد من تقليد المشاهير. يمكن إساءة استخدام التكنولوجيا لإنشاء دعاية سياسية مضللة، ومحتوى إباحي غير مصرح به، وغيرها من المحتويات الضارة. بلغ عدد مقاطع الفيديو المزيفة العميقة على الإنترنت في عام 2023 أرقامًا مذهلة، حيث كانت خوارزميات الذكاء الاصطناعي قادرة على إنتاج ملايين القطع الجديدة يوميًا، وفقًا لدراسة أجرتها Sensity AI.

جهود تشريعية ومشروع قانون “لا للتزييف”

استجابةً لهذه المخاوف، قام ستيف هارفي بنشاط بالدعوة إلى إصلاح تشريعي. يسعى مشروع قانون “لا للتزييف” المقترح إلى فرض عقوبات على الذين يقومون بإنشاء صور وأصوات مولدة بالذكاء الاصطناعي بدون إذن، ويحمل الشركات التقنية مسؤولية المحتوى المستضاف على منصاتها.

– الايجابيات: يوفر المساءلة، يعزز الأصالة، يحمي الحقوق الشخصية والرقمية.

– السلبيات: إمكانية حدوث تعارض مع حقوق التعديل الأول، قد يؤدي إلى تقاضي مفرط قد يعيق حرية التعبير.

حالات الاستخدام الواقعية والاتجاهات السوقية

بينما تحصد إساءة استخدام الذكاء الاصطناعي عناوين الأخبار، تستخدم العديد من الشركات الذكاء الاصطناعي لتحقيق نتائج إيجابية. على سبيل المثال:

– التسويق والتخصيص: تحلل أدوات الذكاء الاصطناعي سلوك المستهلك، مما يعزز تجربة المستخدم من خلال التوصيات المخصصة.

– إنشاء المحتوى: يساعد الذكاء الاصطناعي في إنتاج الموسيقى والفن وحتى سيناريوهات الأفلام بإبداع قريب من الإنسان.

الشركات التقنية تكافح من أجل العودة

تقوم شركات مثل “فيرميليو للذكاء الاصطناعي” بتطوير أدوات مثل “TraceID” لمكافحة التزييفات العميقة بتحديدها وتفكيك المحتوى غير المصرح به بسرعة. وتمثل تقنيتهم وسائل أملية ضد انتشار التزييفات العميقة.

التوقعات للمستقبل

مع تقدم تكنولوجيا الذكاء الاصطناعي، سيكون التحدي هو تحقيق التوازن بين الابتكار والمعايير الأخلاقية والقانونية. يتوقع الخبراء تنظيمات أكثر صرامة وأدوات اكتشاف الذكاء الاصطناعي المحسنة. تقرير فورتشن يشير إلى أن المساءلة في الذكاء الاصطناعي ستصبح جزءًا حاسمًا من السرد في الصناعة خلال السنوات القادمة.

حماية نفسك على الإنترنت: نصائح سريعة

1. ابقَ على اطلاع: قم بتحديث معرفتك بشكل منتظم حول الذكاء الاصطناعي واتجاهات الأمن الرقمي.

2. تحقق من المصادر: تحقق مرتين من صحة الاتصالات أو الطلبات، وخاصة تلك التي تبدو غير عادية.

3. استخدم منصات آمنة: تفاعل مع منصات موثوقة تستفيد من تقنيات مسح محتوى الذكاء الاصطناعي.

الاعتبارات والخلاصة

بينما تستمر مناقشة المحتوى الناتج عن الذكاء الاصطناعي، ما يزال واضحًا الحاجة إلى حلول قوية لتأمين الهويات الرقمية. إن مناصرة ستيف هارفي ليست مجرد حماية المشاهير — بل هي دعوة لحماية وجودنا الرقمي في عصر تتجاوز فيه قدرات الذكاء الاصطناعي الأطر القانونية.

لمزيد من الرؤى حول تأثير الذكاء الاصطناعي على المجتمع، قم بزيارة The Verge.